Marcos Regulatorios para la IA en 2025

Introducción

La Inteligencia Artificial (IA) está transformando rápidamente nuestra sociedad, impulsando innovaciones en diversos sectores, desde la medicina hasta las finanzas. Sin embargo, este rápido avance plantea importantes Consideraciones Éticas y Regulatorias en la IA.

Este artículo profundiza en las consideraciones éticas y los marcos regulatorios que se están desarrollando a nivel global para gobernar la IA en 2025. En primer lugar, exploraremos las regulaciones emergentes, los desafíos que enfrentan las empresas de IA para cumplir con estas normativas, y el impacto significativo del Reglamento General de Protección de Datos (RGPD) en el desarrollo de la IA.

Por lo tanto, comprender estas dinámicas es esencial para cualquier profesional técnico que trabaje con IA, ya que, sin duda, determinarán el futuro de la innovación y la adopción de esta tecnología. Además, a medida que la IA se integra cada vez más en nuestras vidas, se vuelve crucial establecer marcos que garanticen su uso responsable y equitativo.

En consecuencia, la necesidad de un equilibrio entre la innovación y la protección de los derechos individuales se convierte en un imperativo en la era de la IA.

Información de Contexto

El debate sobre la ética en la IA no es nuevo, pero ha cobrado mayor relevancia en los últimos años debido a los avances significativos en el aprendizaje automático y el procesamiento del lenguaje natural. En efecto, desde los primeros sistemas expertos en la década de 1960 hasta los sofisticados algoritmos de aprendizaje profundo de hoy, la IA ha recorrido un largo camino.

No obstante, el potencial de sesgos algorítmicos, la falta de transparencia en los procesos de toma de decisiones de la IA y las preocupaciones sobre la privacidad de los datos han impulsado la necesidad de una regulación más estricta.

De hecho, la Organización para la Cooperación y el Desarrollo Económicos (OCDE) estima que la inversión global en IA podría alcanzar los 126 mil millones de dólares para 2025, según su informe «OECD Digital Economy Outlook 2020«, lo que, por consiguiente, subraya la urgencia de establecer un marco regulatorio sólido y globalmente armonizado.

En cuanto a las tendencias actuales, estas muestran un aumento en la creación de leyes y directrices a nivel nacional e internacional, con un enfoque en la transparencia, la responsabilidad y la rendición de cuentas en el desarrollo y la implementación de sistemas de IA.

Marcos Regulatorios para la IA en 2025

Regulaciones Globales de IA: Un Análisis Comparativo

A nivel global, se están desarrollando diversas iniciativas para regular la IA. Algunos ejemplos clave incluyen:

- Unión Europea: La Ley de IA de la UE propone un enfoque basado en el riesgo, clasificando los sistemas de IA según su nivel de riesgo y estableciendo requisitos específicos para cada categoría. Se centra en la prohibición de prácticas de IA consideradas inaceptables, como la manipulación subliminal o la vigilancia masiva.

- Estados Unidos: Estados Unidos adopta un enfoque más descentralizado, con regulaciones sectoriales y directrices voluntarias. El NIST (Instituto Nacional de Estándares y Tecnología) ha publicado un Marco de Gestión de Riesgos de IA para ayudar a las organizaciones a gestionar los riesgos asociados con la IA.

- China: China está invirtiendo fuertemente en el desarrollo de IA y también está estableciendo regulaciones, con un enfoque en la seguridad nacional y el control del contenido en línea.

- Otros Países: Países como Canadá, Japón y Singapur también están desarrollando sus propias estrategias y regulaciones en materia de IA, a menudo inspirándose en los enfoques de la UE y Estados Unidos.

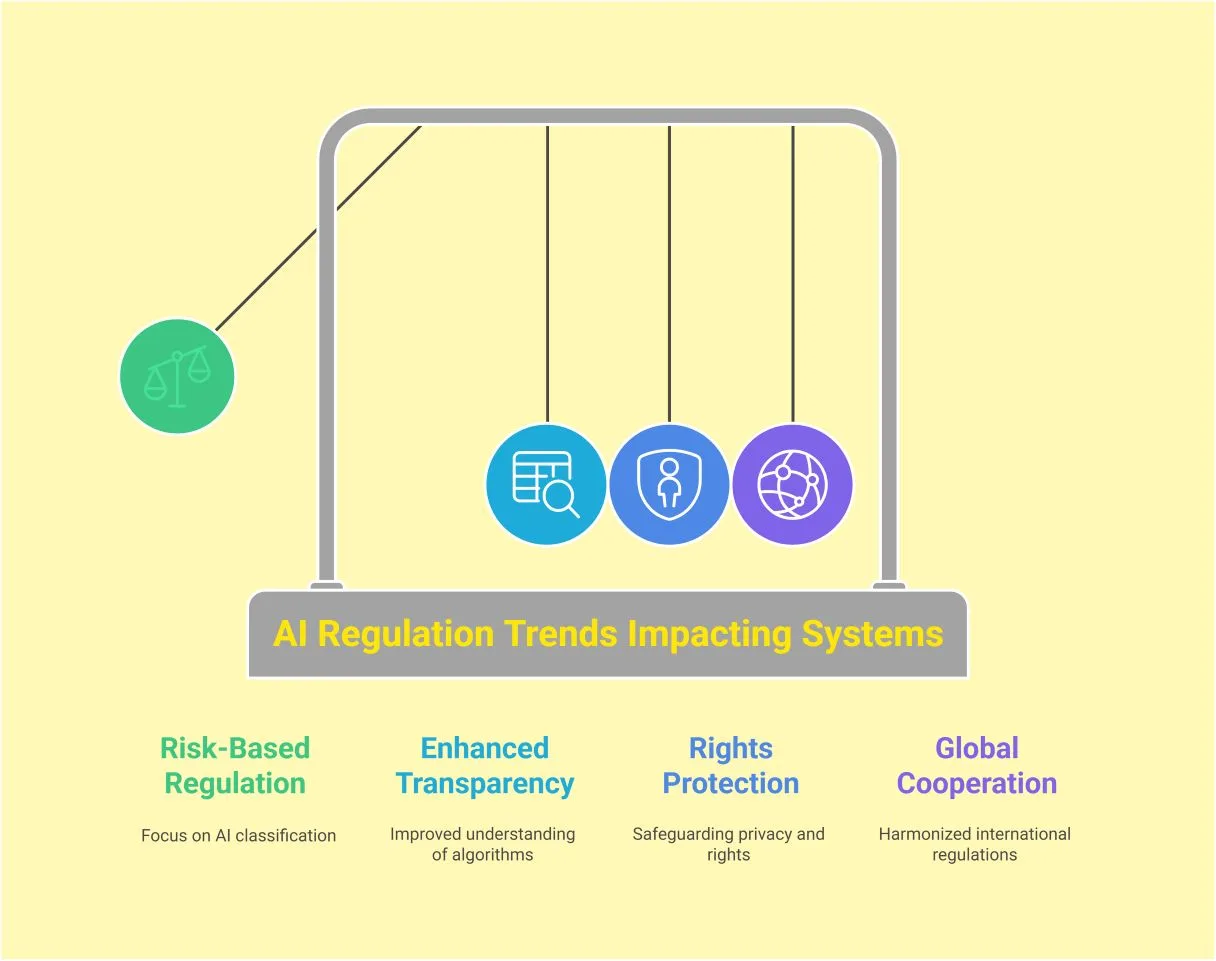

Tendencias en la Regulación de la IA para 2025

- Aumento en la regulación basada en el riesgo: Mayor enfoque en clasificar los sistemas de IA según su nivel de riesgo.

- Énfasis en la transparencia y la explicabilidad: Requisitos para que los algoritmos de IA sean más transparentes y comprensibles.

- Mayor protección de los derechos fundamentales: Enfoque en la protección de la privacidad, la no discriminación y otros derechos fundamentales.

- Colaboración internacional en la regulación de la IA: Mayor cooperación entre países para armonizar las regulaciones.

Desafíos de Cumplimiento para las Empresas de IA

Cumplir con las regulaciones emergentes de IA presenta varios desafíos para las empresas:

- Falta de claridad y armonización: La diversidad de enfoques regulatorios a nivel global dificulta el cumplimiento para las empresas que operan a nivel internacional.

- Complejidad técnica: Demostrar el cumplimiento de requisitos como la explicabilidad y la transparencia puede ser técnicamente complejo.

- Costos de implementación: Adaptar los sistemas de IA para cumplir con las regulaciones puede ser costoso.

- Dificultad para mantenerse al día con los cambios regulatorios: El panorama regulatorio está en constante evolución, lo que exige un seguimiento continuo.

El Impacto del RGPD en el Desarrollo de la IA

El RGPD tiene un impacto significativo en el desarrollo de la IA, especialmente en lo que respecta al procesamiento de datos personales. Algunos aspectos clave incluyen:

- Derecho a la explicación: El RGPD otorga a los individuos el derecho a obtener una explicación sobre las decisiones automatizadas que les afectan.

- Minimización de datos: El principio de minimización de datos exige que solo se recopilen y procesen los datos necesarios para un fin específico.

- Consentimiento informado: El consentimiento para el procesamiento de datos personales debe ser libre, específico, informado e inequívoco.

Ejemplos Prácticos y Estudios de Caso

A continuación, se presentan tres estudios de caso reales que demuestran la implementación de la IA en diferentes sectores, destacando las cinco etapas clave de cada proyecto:

Uso de IA en la Detección de Fraude Bancario

- Etapa 1: Inicio: Un banco busca mejorar la precisión en la detección de transacciones fraudulentas y reducir las pérdidas financieras, que estaban en aumento debido a la sofisticación de las técnicas de fraude.

- Etapa 2: Planificación: Se decide implementar un sistema de IA basado en aprendizaje automático para analizar patrones de transacciones y detectar anomalías en tiempo real. Se asignan recursos para la adquisición de software especializado, la capacitación del personal y la integración con los sistemas existentes. Se define un conjunto de métricas clave, como la tasa de falsos positivos y falsos negativos.

- Etapa 3: Ejecución: Se recopilan datos históricos de transacciones, anonimizando la información sensible para cumplir con las regulaciones de privacidad. Se utilizan estos datos para entrenar el modelo de IA, ajustando los algoritmos para optimizar la precisión. Se implementan medidas de seguridad robustas para proteger la privacidad de los datos durante todo el proceso.

- Etapa 4: Evaluación: Se miden las tasas de detección de fraude antes y después de la implementación del sistema de IA, comparando los resultados con las métricas definidas en la etapa de planificación. Se evalúa la reducción en las pérdidas financieras y el impacto en la experiencia del cliente, minimizando las interrupciones por falsas alarmas.

- Etapa 5: Lecciones Aprendidas: Se identifica la importancia crítica de la calidad y la limpieza de los datos para la precisión del modelo. Se aprende la necesidad de una monitorización continua del sistema para detectar posibles sesgos o cambios en los patrones de fraude, adaptando el modelo a las nuevas técnicas de fraude.

IA en el Diagnóstico Médico

- Etapa 1: Inicio: Un hospital busca mejorar la precisión y la eficiencia en el diagnóstico de enfermedades complejas, como el cáncer, reduciendo los tiempos de espera y mejorando los resultados para los pacientes.

- Etapa 2: Planificación: Se decide implementar un sistema de IA basado en el análisis de imágenes médicas (radiografías, resonancias magnéticas, etc.) para asistir a los radiólogos en la detección temprana de anomalías. Se seleccionan algoritmos de aprendizaje profundo especializados en el análisis de imágenes médicas y se planifica la integración con el sistema de gestión de imágenes del hospital.

- Etapa 3: Ejecución: Se recopila un conjunto de datos anonimizados de imágenes médicas etiquetadas por expertos para entrenar al modelo de IA. Se realizan pruebas rigurosas para validar la precisión y la sensibilidad del sistema. Se implementa el sistema en un entorno de prueba antes de su despliegue completo.

- Etapa 4: Evaluación: Se compara el rendimiento del sistema de IA con el de los radiólogos humanos, midiendo la precisión en la detección de anomalías y el tiempo necesario para realizar los diagnósticos. Se recopilan comentarios de los profesionales médicos para mejorar la usabilidad del sistema.

- Etapa 5: Lecciones Aprendidas: Se aprende la importancia de la colaboración entre ingenieros y profesionales médicos para el desarrollo y la validación de sistemas de IA en el ámbito de la salud. Se identifica la necesidad de una formación continua para el personal médico en el uso de estas nuevas tecnologías.

IA en la Gestión de Recursos Humanos

- Etapa 1: Inicio: Una empresa con un alto volumen de solicitudes de empleo busca optimizar el proceso de selección de personal, reduciendo el tiempo dedicado a la revisión manual de currículums y mejorando la calidad de las contrataciones.

- Etapa 2: Planificación: Se decide implementar un sistema de IA para automatizar el filtrado de currículums, identificando a los candidatos más adecuados según los requisitos del puesto. Se definen los criterios de selección y se selecciona una plataforma de IA especializada en la gestión de recursos humanos.

- Etapa 3: Ejecución: Se configura el sistema de IA para analizar los currículums y extraer información relevante, como la experiencia laboral, las habilidades y la formación académica. Se integra el sistema con la plataforma de gestión de candidatos de la empresa. Se realizan pruebas para asegurar la precisión del sistema y evitar sesgos discriminatorios.

- Etapa 4: Evaluación: Se mide el tiempo dedicado al proceso de selección antes y después de la implementación del sistema de IA. Se evalúa la calidad de las contrataciones, midiendo el rendimiento de los nuevos empleados y la tasa de rotación.

- Etapa 5: Lecciones Aprendidas: Se identifica la importancia de definir criterios de selección claros y objetivos para evitar sesgos en el sistema de IA. Se aprende la necesidad de una revisión humana del proceso para garantizar la equidad y la transparencia. Se destaca la importancia de la comunicación con los candidatos durante todo el proceso de selección.

Estos ejemplos ilustran cómo la IA se está aplicando en diversos sectores para mejorar la eficiencia, la precisión y la toma de decisiones. Cada caso destaca la importancia de una planificación cuidadosa, una ejecución rigurosa y una evaluación continua para garantizar el éxito de los proyectos de IA.

Beneficios

La implementación de marcos éticos y regulatorios en la IA ofrece numerosos beneficios:

- Mayor confianza pública: La regulación ayuda a generar confianza en la IA, lo que facilita su adopción.

- Mitigación de riesgos: La regulación ayuda a prevenir el uso malintencionado de la IA y a mitigar los riesgos asociados con su implementación.

- Fomento de la innovación responsable: Un marco regulatorio claro fomenta la innovación al proporcionar seguridad jurídica a las empresas.

- Protección de los derechos fundamentales: La regulación ayuda a proteger los derechos individuales, como la privacidad y la no discriminación.

Desafíos y Limitaciones

Existen varios desafíos y limitaciones en la implementación de marcos éticos y regulatorios en la IA:

- Dificultad para definir la IA: La falta de una definición única y universalmente aceptada de IA dificulta la creación de regulaciones específicas.

- Rápido avance tecnológico: El rápido ritmo de la innovación en IA dificulta que las regulaciones se mantengan al día.

- Equilibrio entre regulación e innovación: Es importante encontrar un equilibrio entre la regulación y la promoción de la innovación.

- Aplicación global: La falta de armonización global en las regulaciones de IA presenta un desafío para las empresas que operan a nivel internacional.

Perspectivas Futuras

El futuro de la regulación de la IA se caracteriza por:

- Mayor enfoque en la explicabilidad y la transparencia: Se espera que las futuras regulaciones exijan una mayor transparencia en el funcionamiento de los algoritmos de IA, permitiendo comprender cómo se toman las decisiones.

- Desarrollo de estándares internacionales: Se prevé una mayor colaboración internacional para desarrollar estándares comunes en la regulación de la IA.

- Regulación específica para diferentes sectores: Se espera una mayor especialización de las regulaciones, adaptándose a las necesidades específicas de cada sector, como la salud, las finanzas o el transporte.

- Mayor atención a la IA generativa: El auge de la IA generativa requerirá nuevas regulaciones para abordar los desafíos específicos que plantea, como la creación de contenido falso o la infracción de derechos de autor.

Conclusiones

En efecto, la ética y la regulación de la IA son temas cruciales en el panorama tecnológico actual. A medida que la IA continúa evolucionando y transformando nuestras vidas, es esencial, por lo tanto, establecer marcos regulatorios sólidos que garanticen su uso responsable y equitativo.

Ahora bien, aunque las empresas de IA enfrentan desafíos significativos para cumplir con estas regulaciones, la adopción de un enfoque proactivo y la inversión en soluciones técnicas que faciliten el cumplimiento son fundamentales para garantizar el éxito a largo plazo. De hecho, los marcos regulatorios para la IA en 2025 se caracterizarán por un enfoque basado en el riesgo, un mayor énfasis en la transparencia y la explicabilidad, y una mayor protección de los derechos fundamentales. A este respecto, el RGPD ha sentado un precedente importante en la regulación del procesamiento de datos personales y su impacto en el desarrollo de la IA es innegable.

En última instancia, el objetivo primordial es encontrar un equilibrio entre la promoción de la innovación en IA y la protección de los valores éticos y los derechos individuales. En consecuencia, el futuro de la IA depende de nuestra capacidad para abordar estas consideraciones de manera efectiva y construir un ecosistema de IA responsable y confiable.

Además, la inversión en investigación, el diálogo entre los diferentes actores involucrados (gobiernos, empresas, academia y sociedad civil) y la educación continua son fundamentales para navegar este complejo panorama y aprovechar al máximo el potencial transformador de la IA.

Finalmente, la colaboración internacional y el desarrollo de estándares comunes serán clave para lograr una regulación efectiva y armonizada a nivel global.

Referencias

A continuación, se presentan tres referencias clave que proporcionan información relevante sobre las consideraciones éticas y regulatorias en la IA:

Comisión Europea – Propuesta de Reglamento del Parlamento Europeo y del Consejo por el que se establecen normas armonizadas sobre inteligencia artificial(Ley de Inteligencia Artificial): https://eur-lex.europa.eu/legal-content/ES/TXT/?uri=CELEX%3A52021PC0206. Esta es la fuente principal sobre la propuesta de la Ley de IA de la UE, que establece un marco legal para regular la IA en la Unión Europea. Proporciona detalles sobre las categorías de riesgo, las obligaciones para los proveedores y usuarios de sistemas de IA, y las prohibiciones de ciertas prácticas de IA.

NIST – AI Risk Management Framework (RMF): https://www.nist.gov/itl/ai-risk-management-framework. El Marco de Gestión de Riesgos de IA (RMF) del NIST ofrece una guía para ayudar a las organizaciones a identificar, evaluar y gestionar los riesgos asociados con los sistemas de IA. Proporciona un enfoque práctico y adaptable para la gestión de riesgos en diferentes contextos y sectores.

Reglamento General de Protección de Datos (RGPD): https://eur-lex.europa.eu/eli/reg/2016/679/oj. El RGPD es un reglamento de la UE sobre la protección de las personas físicas en lo que respecta al tratamiento de datos personales y a la libre circulación de estos datos. Tiene un impacto significativo en el desarrollo y la implementación de sistemas de IA que procesan datos personales, estableciendo principios como la minimización de datos, la transparencia y el derecho a la explicación.