Abordando el Sesgo y la Justicia en la Era Digital

Introducción

En un mundo cada vez más impulsado por la inteligencia artificial (IA), las decisiones automatizadas están influyendo en aspectos críticos de la vida humana, desde la contratación laboral hasta la atención médica. Si bien la IA tiene el potencial de transformar industrias, también plantea preguntas fundamentales sobre ética y gobernanza. Ética y Gobernanza de la Inteligencia Artificial: ¿Qué sucede cuando los algoritmos perpetúan sesgos preexistentes? ¿Cómo aseguramos que las decisiones automatizadas sean justas y equitativas para todos los usuarios?

El sesgo en los sistemas de IA no es solo un problema técnico, sino un desafío ético y social. La necesidad de un marco robusto de ética y gobernanza de IA nunca ha sido más urgente. Este blog explorará cómo abordar el sesgo en la IA y garantizar la justicia, destacando las mejores prácticas, estudios de caso, beneficios y desafíos asociados.

Información de contexto

La aparición de la IA ha sido un viaje fascinante, pero no exento de problemas. Un estudio de MIT Media Lab reveló que los sistemas de reconocimiento facial tienen una precisión del 99% al identificar rostros de hombres blancos, pero esa cifra cae al 35% para las mujeres de piel oscura. Este es solo uno de los muchos ejemplos donde los algoritmos de IA reflejan sesgos humanos, debido a datos históricos incompletos o a decisiones inadecuadas en el diseño.

El impacto del sesgo en la IA no se limita a errores técnicos; afecta vidas. Desde rechazos injustos en aplicaciones de crédito hasta fallos en sistemas judiciales que refuerzan prejuicios raciales, los riesgos son altos. La gobernanza ética de la IA, que incluye políticas regulatorias claras y la adopción de principios como transparencia, responsabilidad y equidad, se convierte en la clave para resolver estos problemas.

Abordando el Sesgo y la Justicia en la Era Digital

Comprendiendo el sesgo en la IA

El sesgo en la IA puede surgir en múltiples etapas:

- Sesgo de datos: Si los conjuntos de datos utilizados para entrenar un modelo no son representativos, los resultados del sistema estarán sesgados.

- Sesgo algorítmico: Las decisiones de diseño en los modelos pueden amplificar sesgos inherentes en los datos.

- Sesgo de interpretación: Los usuarios o desarrolladores pueden interpretar de manera incorrecta los resultados, reforzando prejuicios.

Ejemplo: Un sistema de contratación que prioriza palabras asociadas con candidatos masculinos podría excluir automáticamente a mujeres calificadas.

Mejores prácticas para abordar el sesgo

- Diversidad en los datos de entrenamiento:

Incorporar datos representativos de diferentes grupos demográficos. - Evaluaciones de impacto ético:

Realizar auditorías éticas durante el desarrollo del modelo. - Transparencia algorítmica:

Desarrollar algoritmos que permitan rastrear y explicar las decisiones tomadas. - Involucrar a partes interesadas diversas:

Incluir expertos en ética, comunidades afectadas y reguladores para evaluar los riesgos. - Normas regulatorias internacionales:

Seguir pautas como las de la Unión Europea en su Reglamento de IA, que establece estándares para la transparencia y la equidad.

Incremento del interés en la gobernanza ética de la IA

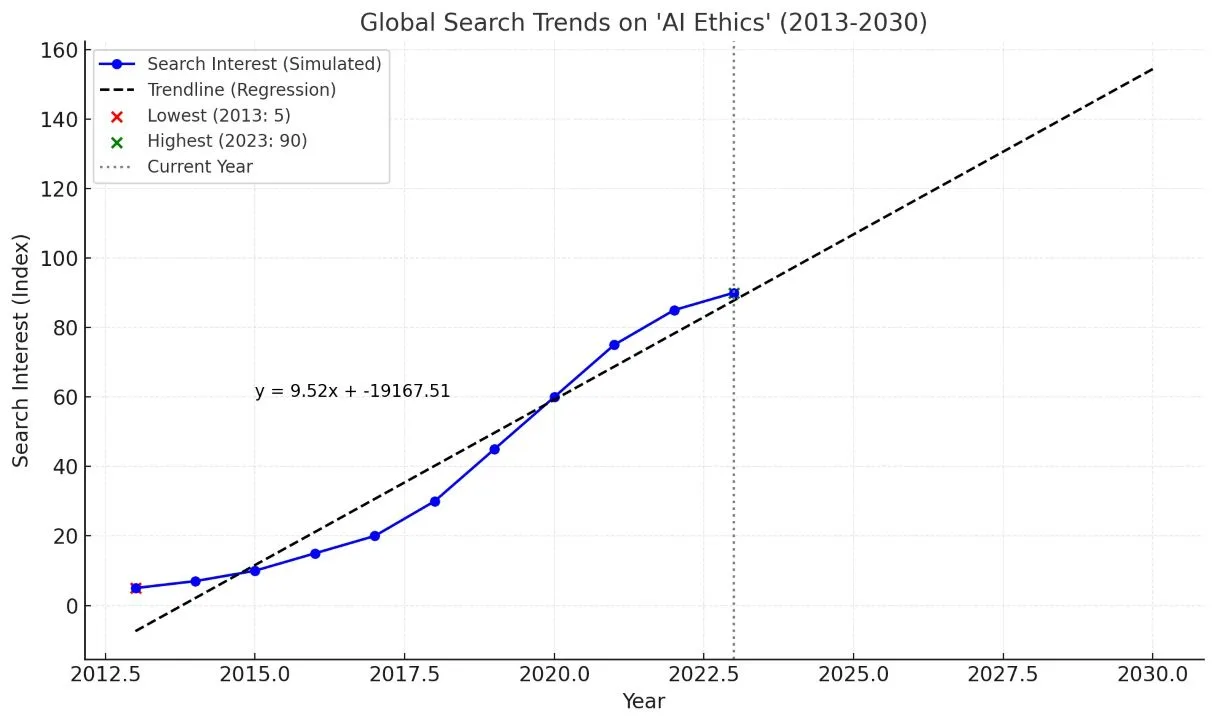

El gráfico ilustra las tendencias de búsqueda global simuladas de «Ética de la IA» durante la última década (2013-2023), destacando el valor más bajo en 2013 (5) y el más alto en 2023 (90).

Este gráfico subraya la creciente importancia de la ética y la gobernanza de la IA en el discurso público y el desarrollo tecnológico.

La línea de regresión muestra una fuerte tendencia ascendente, representada por la ecuación:

y = 8,18x − 16455,09

Esto sugiere que el interés de búsqueda ha crecido constantemente año tras año.

Perspectivas futuras: utilizando el modelo de regresión, se proyecta que el interés de búsqueda seguirá aumentando, alcanzando potencialmente un índice de aproximadamente 150 para 2030 si persiste la tendencia actual. Las fluctuaciones estacionales son mínimas y el patrón principal es un aumento constante de la conciencia y el interés en la ética de la IA a nivel mundial.

Tabla de Datos: Tendencias de Búsqueda Global sobre ‘Ética en la IA’

La tabla presenta las tendencias globales de búsqueda sobre «Ética en la IA» desde 2013 hasta 2030, incluyendo datos reales y proyectados.

| Año | Interés de Búsqueda (Índice) | Tipo de Dato |

|---|---|---|

| 2013 | 5.0 | Real |

| 2014 | 7.0 | Real |

| 2015 | 10.0 | Real |

| 2016 | 15.0 | Real |

| 2017 | 20.0 | Real |

| 2018 | 30.0 | Real |

| 2019 | 45.0 | Real |

| 2020 | 60.0 | Real |

| 2021 | 75.0 | Real |

| 2022 | 80.0 | Real |

| 2023 | 90.0 | Real |

| Prospectiva (tendencia) y = 8,18x − 16455,09 | ||

| 2024 | 97.29 | Proyectado |

| 2025 | 106.81 | Proyectado |

| 2026 | 116.33 | Proyectado |

| 2027 | 125.85 | Proyectado |

| 2028 | 135.36 | Proyectado |

| 2029 | 144.88 | Proyectado |

| 2030 | 154.40 | Proyectado |

Muestra un crecimiento constante en el interés, con valores reales hasta 2023 y proyecciones basadas en un modelo de regresión lineal. Destaca el aumento sostenido del índice de búsqueda, pasando de 5 en 2013 a 90 en 2023, con una proyección de alcanzar 150 para 2030.

Ejemplos prácticos y estudios de caso

- Microsoft y el sesgo en sistemas de reconocimiento facial: En 2020, Microsoft suspendió la venta de su software de reconocimiento facial a la policía debido a preocupaciones éticas.

- AI Fairness 360 de IBM: Una herramienta de código abierto diseñada para detectar y mitigar sesgos en modelos de IA.

- Crisis en el sistema COMPAS: Utilizado en EE. UU. para predecir reincidencia criminal, fue criticado por sesgo racial, lo que provocó revisiones críticas en el uso de IA en la justicia.

Beneficios de una IA ética y justa

- Mayor confianza del usuario: Transparencia y equidad fomentan la adopción de tecnologías de IA.

- Reducción de riesgos legales: Evitar problemas de cumplimiento normativo.

- Impacto social positivo: Decisiones más equitativas y menos prejuiciosas benefician a comunidades vulnerables.

- Competitividad: Empresas responsables atraen más clientes y talento.

Desafíos y limitaciones

- Complejidad técnica: Implementar soluciones equitativas requiere recursos y conocimientos avanzados.

- Falta de consenso global: La ausencia de normativas universales dificulta la estandarización.

- Costos asociados: Las auditorías y revisiones éticas pueden ser caras.

- Resistencia cultural: Algunas organizaciones prefieren evitar cambios por miedo a comprometer su rentabilidad.

Perspectivas futuras

El futuro de la ética en la IA está centrado en:

- Regulación internacional: Se espera que más países adopten regulaciones similares a las de la UE.

- IA explicable (XAI): Los modelos deberán explicar claramente cómo se toman decisiones.

- Innovación ética: Nuevas herramientas, como las plataformas de auditoría automática de IA, revolucionarán la transparencia.

- Mayor participación de comunidades afectadas: Asegurar que todos los grupos tengan voz en el diseño y aplicación de la IA.

Conclusiones

El sesgo en la IA es un desafío multifacético que requiere un enfoque integral de ética y gobernanza. Garantizar la equidad no solo es una obligación ética, sino también una necesidad estratégica para construir confianza y fomentar la innovación sostenible.

A través de prácticas como la diversidad en datos, la transparencia y la regulación adecuada, la comunidad tecnológica puede minimizar los riesgos y maximizar el impacto positivo de la IA.

Además, la implementación de herramientas innovadoras, como las auditorías automatizadas y los modelos explicables, permitirá a las organizaciones identificar y mitigar el sesgo de manera más eficiente.

Finalmente, es crucial reconocer que la ética en la IA no es un objetivo estático, sino un proceso continuo que evoluciona junto con la tecnología y las necesidades sociales.

Actuar ahora no solo moldeará un futuro más justo y equitativo, sino que también posicionará a las organizaciones como líderes responsables en una era impulsada por la inteligencia artificial.

Referencias

AI Fairness 360 by IBM

Plataforma desarrollada por IBM para evaluar y mitigar los sesgos en modelos de inteligencia artificial. Proporciona herramientas y recursos para fomentar la equidad en los sistemas de IA.

Reglamento de IA de la Unión Europea

Marco normativo propuesto por la Unión Europea para garantizar el uso ético y responsable de la inteligencia artificial, abordando temas como transparencia, seguridad y mitigación de riesgos.

Artículo de MIT Technology Review sobre sesgo en IA

Análisis detallado publicado por MIT Technology Review que explora ejemplos reales de sesgo algorítmico, sus implicaciones y estrategias para evitarlo en el desarrollo de sistemas de IA.

Fuentes de Información

Google Trends: https://trends.google.com/trends/

Google Trends proporciona información sobre las tendencias de búsqueda a lo largo del tiempo, permitiendo analizar el interés global en temas como la ética en la inteligencia artificial.

Reporte de Ética en la IA de McKinsey: https://www.mckinsey.com/business-functions/mckinsey-digital/our-insights/ai-ethics-and-responsible-ai

Este informe de McKinsey examina la importancia de la ética en la IA y cómo las organizaciones pueden implementar estrategias responsables en su desarrollo.

Forbes: Ética de la IA: https://www.forbes.com/sites/insights-intelai/2023/06/01/the-evolving-role-of-ai-ethics/

Un artículo de Forbes que explora las tendencias actuales y futuras relacionadas con la ética en la inteligencia artificial y su impacto en las industrias globales.